2026-05-10

微软最近开源了一个创新专属模型Phi-Ground-Any-4B,是从Phi-3.5-vision-instruct基础之上微调而成的。

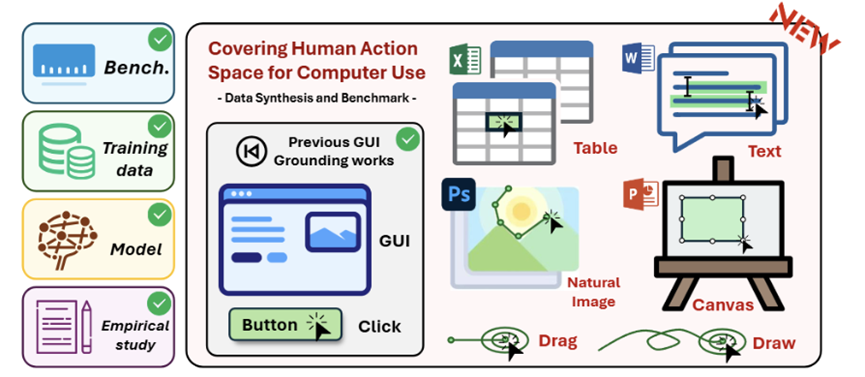

Any-4B只专注干一件事,就是你告诉它图片里要找什么,就能给你指出来那个东西在哪。

听起来好像不算啥新鲜事对吧,但等你真正上手用过就会发现,这玩意确实有点东西。

开源地址:https://huggingface.co/microsoft/Phi-Ground-Any

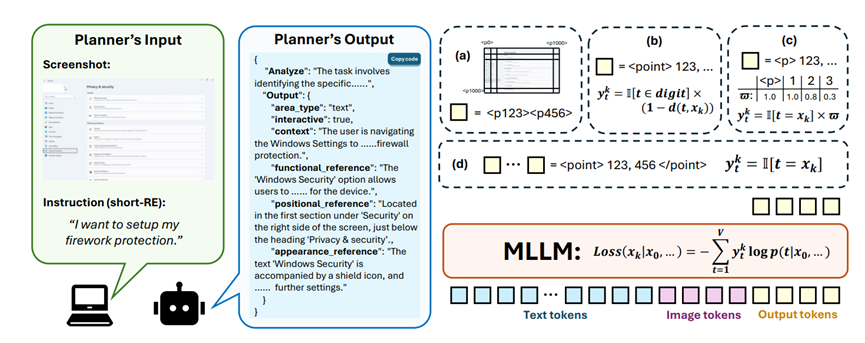

咱们就好好唠唠这个新模型的亮点功能。Any-4B对输入图片的分辨率有固定要求,必须得是1680乘1008这个尺寸。

你可能会好奇为啥偏偏是这个数字,其实是因为它内部用的是5乘3的网格画布,每个小格子336像素,5乘336就是1680,3乘336就是1008。

你可以把它想象成一块白板,上面画了15个方格,你的图片会被缩放后贴到这块白板的左上角,剩下的空白区域就用白色填满。

这么设计的好处是什么呢,就是模型看到的每张图片格式都是统一的,不用来回适应不同尺寸,处理起来更稳定更高效。就好比你读书的时候,老师总要求统一用某种格式的笔记本,看着整齐,批改也方便。

跟这个模型交互的时候,你得先说指令,然后再给图片,顺序不能乱。它不像有些模型你可以随意编排输入顺序,这里必须严格遵守指令在先图片在后。

而且它还要求带系统提示词,整体格式是比较死板的。不过这种死板换来的是稳定性,你按它的规矩来,它就能稳稳当当地给你反馈结果。

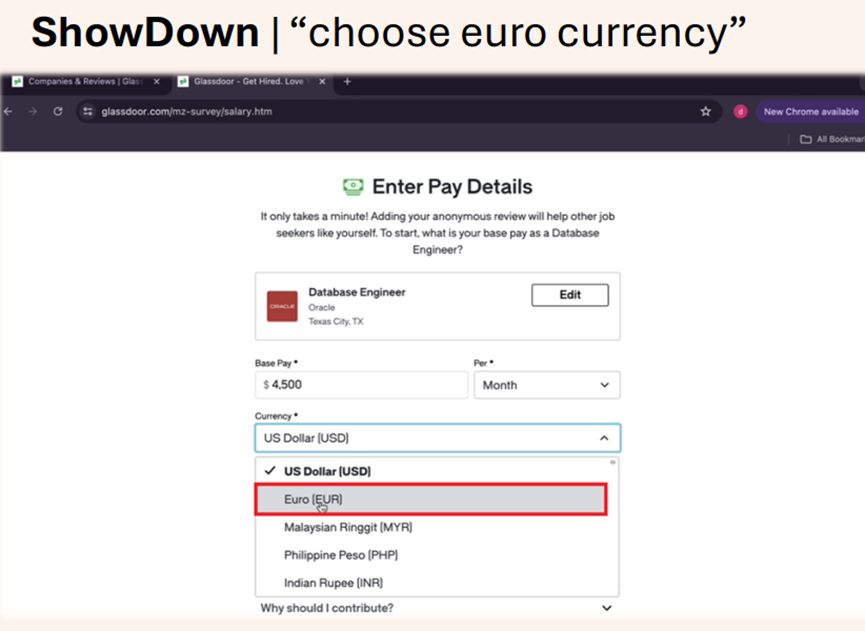

那给你的答案长啥样呢?这个部分可能是最让人挠头的地方了。模型输出的结果不是那种你能一眼看懂的文字描述,而是一串数字。

AI会把你想要定位的那个点,用两个0到10000之间的数值来表示横纵坐标,然后以特定的标签格式输出。

这两个数值代表的是在它那块1680*1008白色画布上的相对位置,而不是你原始图片上的像素位置。

所以如果你想得到原图上真正的像素坐标,还需要做一层换算。换算过程说起来也不算太复杂,先把数值除以10000得到比例,再乘以画布的宽或高拿到画布上的像素坐标。

最后再除以之前缩放图片时产生的缩放比例,就能还原出原图上的真实位置了。

打个比方,就好像你拿了一张缩小版的地图,上面标注了某个地点的比例坐标,你要想知道实际位置,得先按地图比例尺算出地图上的厘米数,再换算回真实世界的距离。

跑这个模型需要一些依赖包,transformers要4.43.0版本,torch要2.3.0版本,flash_attn要2.5.8版本。

还有numpy、Pillow、Requests、torchvision、accelerate这些,各自都有对应的版本号。建议大家在配环境的时候严格按照它给的版本来。

配好环境之后,你可以选择用huggingface的transformers库来跑推理,也可以用vllm来跑。

两种方式各有各的好处,huggingface的方式上手简单文档也多,适合刚接触的朋友;vllm的话在大批量推理的时候速度优势比较明显,适合对性能有更高要求的场景。

我觉得这个模型最大的特点就是专而精。不搞那些花里胡哨的多功能,就专注在图片定位这一件事上,而且做到了足够好用。

4B的参数量也不算大,普通显卡就能跑得动,不像有些动辄上百亿参数的模型,光加载就要等半天。

当然也不是没缺点,输出坐标需要二次换算这事儿确实有点折腾,对纯小白来说上手还是得稍微动点脑筋。

如果你手头正好有图片目标定位的需求,比如搞搞数据标注或者做个交互式小工具,那它真的值得一试。

想系统掌握AI核心技能、获取行业认可资质?

CAIE注册人工智能工程师认证

助你拓宽职业赛道,成为AI领域持证实力派

企业、高校及渠道合作

请联系微信:FYLlaoshi

完 谢谢观看