2026-05-02

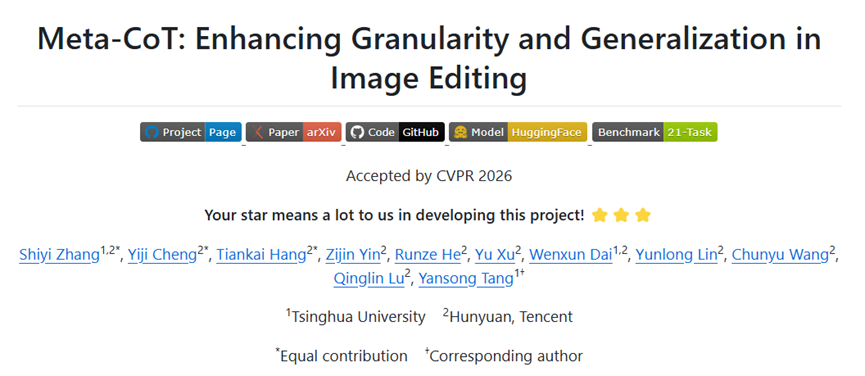

清华和腾讯混元团队最近联手开源了一个新框架Meta-CoT,刚被CVPR 2026收录。

简单来说,Meta-CoT就是教AI修图模型学会想清楚了再动手。你给的指令越复杂,它越能拆得明明白白,最后出来的效果也就越精准。

开源地址:https://github.com/shiyi-zh0408/Meta-CoT

咱们先看下展示的效果,例如,把这个图片直接转换成十字绣风格。

把一批马变成红砖风格的,其他场景都不变。

除了变换风格之外,也能快速抠图。例如,把一位女子从图像中快速抠出来。

其实这里比PS要更厉害一些。因为咱们用通道、钢笔扣完图之后,那个地方像素直接就被破坏了,还需要人工来修复。

而Meta-CoT不仅把人物抠出来了,还自动修复了受损图片真的很强。

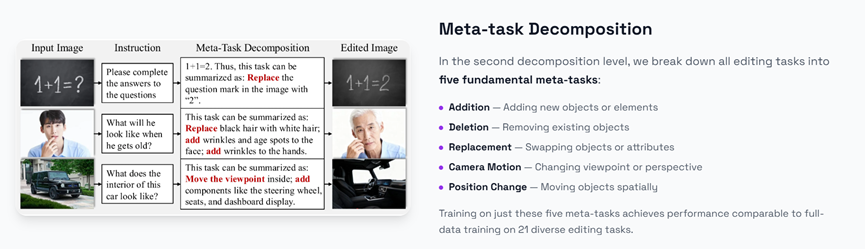

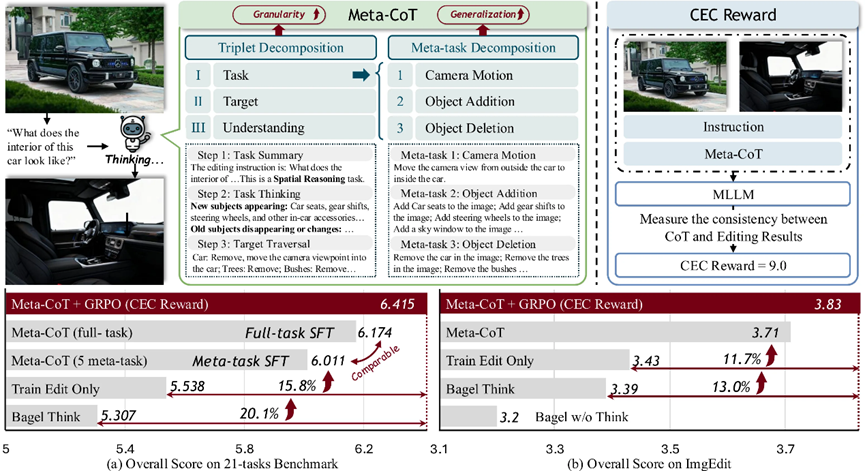

看到这里你可能会好奇,Meta-CoT是怎么做到这么精准的。其实答案藏在两步分解机制里。

第一步,把你说的任何编辑需求拆成三个东西:你要做什么类型的操作、改的是哪个部分、模型需要什么水平的理解力来配合。

举个例子,你说把照片里的红苹果换成绿的。Meta-CoT会先判断出来,操作类型是替换,目标是苹果的颜色,理解力上要求模型能认出苹果并且分得清红和绿。

有点像你去理发店,老手师傅不会一上来就抄剪子,而是先问清楚你是想修短一点还是换个造型,日常用还是正式场合穿。问清楚了再动手,出来的效果才不会翻车。

第二步分解就更有意思了。研究团队总结出一个规律,不管你提的编辑需求看上去多花哨,本质上都可以拆成五种最基本的操作:添加东西、删掉东西、替换元素、切换视角、移动位置。

就像乐高积木一样,基础块的种类其实很少,但组合起来能拼出无穷无尽的花样。

他们只在这五种元任务上训练模型,结果模型竟然能泛化到超过二十一种编辑任务。日常你能想到的修图需求,基本都覆盖了。

除了这两层分解,项目还搭了一套一致性检查机制。通俗点说,就是看模型想的过程和最终做出来的结果是不是一致的。

就好比考试的时候,老师不只看你答案写得对不对,还得看你的解题步骤是不是合理。如果模型心里盘算的是把背景改成蓝色。

最后出来的图片背景偏偏是红色的,那这个分数就会很低,模型就会被纠正回来,下次就不会犯同样的错。

数据层面也能验证这套方法确实管用。在二十一项编辑任务的基准测试上,Meta-CoT比之前最强的方法整体高出15.8%。

在ImgEdit基准上比BAGEL高出13%。了解AI学术界的朋友应该清楚,在顶会论文里几个百分点的提升就已经算很突出了,十几的差距基本就是代际级别的领先。

如果你想深入研究或者拿它来搭自己的编辑管线,这个开源项目也留了足够的余地。

SFT阶段的训练代码全部开放了,数据加载支持Parquet分片格式,处理大规模数据集的效率还不错。不同数据配比怎么影响最终效果,你可以自己调整参数去实验。

团队还顺手发布了一个二十一种编辑任务的基准测试集,覆盖面从简单的风格迁移一直到复杂的多元素编辑。

你可以拿它来评估不同模型在各类场景下的表现,或者当自己研究的参照基准。

对AI图像编辑感兴趣的朋友,或者工作里需要批量处理图片编辑的,这个项目确实值得花时间看看。

CVPR 2026已经接收了,代码和技术方案的质量是有背书的。

想系统掌握AI核心技能、获取行业认可资质?

CAIE注册人工智能工程师认证

助你拓宽职业赛道,成为AI领域持证实力派

企业、高校及渠道合作

请联系微信:FYLlaoshi

完 谢谢观看

上一篇: 别只盯着提示词了,未来值钱的其实是AI的决策能力 下一篇: 为什么很多人学了很久AI,收入却没涨?