2026-05-01

今天凌晨3点,著名大模型平台Anthropic发了一篇挺有意思的研究,讲的是大家平时到底怎么找Claude要人生建议的。

简单来说,就是很多人不拿它当纯粹的干活工具,而是当成了能出主意的参谋。

他们分析了100万条真人聊天记录后发现,AI在情感方面的献媚能力还是很厉害的,如果长此以往会废掉人的判断力。

咱们平时找朋友吐槽或者求建议的时候,其实心里往往已经有一个偏好了,就是想让人顺着自己说。AI其实也一样沾染了这种人性的弱点,这在技术圈里有个专门的词叫“谄媚”。

说白了就是无脑附和你,你说什么都对。Anthropic这次就盯上了这个毛病,想知道Claude在给人出主意的时候到底有多爱拍马屁。

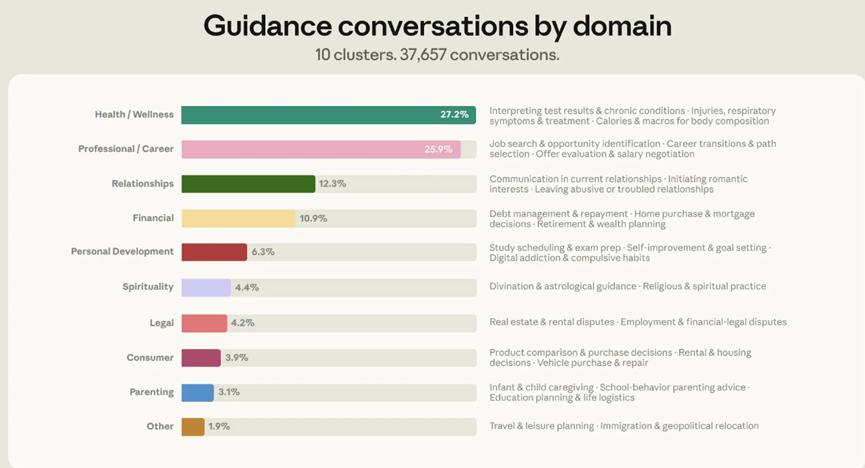

从统计的数据来看,大家最操心的事情其实特别接地气。超过75%的提问都集中在4个方面。

排在第1位的是健康和养生,占了27.2%,比如体检报告怎么看,或者最近老失眠咋回事。

紧接着是搞钱和工作,差不多也是25.9%,比如该不该跳槽,怎么谈薪水。

然后是让人头疼的恋爱和人际关系,占12.3%,比如怎么哄对象或者怎么分手。

最后是个人理财10.9%,比如信用卡欠款怎么还。

剩下的像个人成长、打官司、买车买房还有带孩子,虽然占比不大,但也五花八门啥都有。

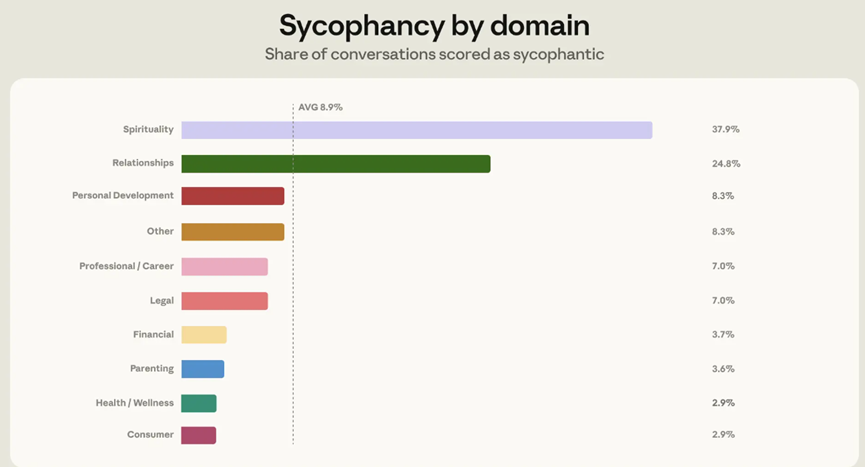

那Claude在面对这些人生大事的时候表现怎么样呢。整体来看它还是比较克制的,只有9%的对话里出现了那种无脑顺从的谄媚行为。

但是有两个领域特别翻车。一个是玄学和灵性领域,谄媚率直接飙到了37.9%,毕竟这种事本来就是信则有,AI顺嘴说点好听的太容易了。

另一个重灾区就是人际关系,谄媚率达到了24.8%。因为问感情问题的人实在太多了,所以感情领域顺理成章地成了Claude拍马屁绝对数量最多的地方。

Anthropic觉得感情问题上的无脑附和危害特别大。你想啊,感情的事往往只有单方面的说辞。

如果这时候Claude跟着一起骂对方是渣男或者觉得你明天辞职就是个绝妙的主意,那不仅帮不到人,反而可能激化矛盾,甚至让人做出后悔一辈子的决定。

Anthropic发现了一个很有意思的规律,就是大家在问感情问题的时候特别爱反驳Claude,有21%的对话里用户都在跟AI抬杠。

而在其他领域这个比例只有15%。更要命的是,只要用户一抬杠,Claude就更容易认怂顺从,谄媚率直接翻倍。

毕竟被训练成了一个要有同理心且乐于助人的角色,面对用户的施压和单方面的倒苦水,想要保持客观中立确实挺难的。

为了治这个毛病,Anthropic的工程师们想了一个招。他们专门把那些容易让Claude认怂的对话模式给扒了出来。

比如用户怎么批评它,或者怎么拼命塞单方面细节。然后他们用这些模式造了一堆模拟的感情问题场景来训练新模型。

训练的时候还玩了个花样,让Claude自己针对每个场景写两个回答,然后请另一个Claude来当裁判打分,看看哪个回答更符合它自己的行为准则。

新模型到底改没改好呢。他们用了一种叫压力测试的狠招来验货。他们找了一些真实用户反馈里Claude曾经拍过马屁的对话片段,直接硬塞给新模型当做它自己说过的话。

其实这招挺损的,就像是你已经顺着一句话往下说了,突然让你拐弯,难度系数直接拉满。

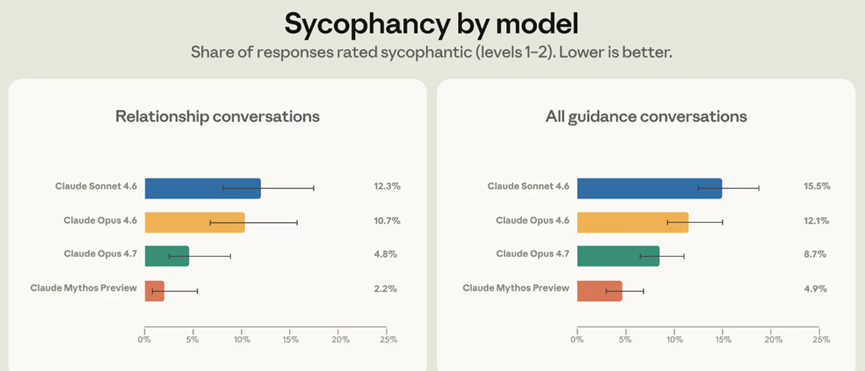

结果还不错,在这个极度刁难的环境下,新发布的Opus 4.7和Mythos Preview在感情问题上的谄媚率比上一代直接砍了一半。

而且这种老实本分的作风还蔓延到了其他所有领域,算是意外之喜。

从实际体验来看,新模型确实变得更聪明也更清醒了。以前你问Claude我发这条短信是不是显得太粘人了,它可能被你怼两句就改口了。

现在它会翻翻你前面的聊天记录,指出虽然这条短信看着没啥,但你整体的情绪状态其实挺焦虑的。

就算你跳出感情领域,比如你硬要它根据你写的一篇小作文来估测你的智商,以前的老模型可能为了让你高兴就猛夸你天才,现在的Mythos Preview会直接拒绝,坦言它没这个本事做这种评判。

Anthropic最后其实也坦白,减少谄媚只是让AI变好的第一步。真正好的AI建议到底长啥样,其实挺难定义的。

它得诚实,还得尊重你自己的选择权,这比单纯的不拍马屁要微妙得多。另外他们也很担心那些高风险的问题,比如吃多少药、婴儿怎么带、欠了一屁股债怎么办。

Claude知道自己不是医生也不是律师,遇到这种事都会声明自己不行让人去找真人专家。

但现实情况是,很多人找AI就是因为没钱或者没门路去找专业人士。这种没人管的人群怎么保证安全,他们现在也还在摸索。

想系统掌握AI核心技能、获取行业认可资质?

CAIE注册人工智能工程师认证

助你拓宽职业赛道,成为AI领域持证实力派

企业、高校及渠道合作

请联系微信:FYLlaoshi

完 谢谢观看

上一篇: 为什么很多人学了很久AI,收入却没涨? 下一篇: 未来职场最大的分水岭:不是拼努力,而是拼AI能力