2026-04-22

今天凌晨4点20,OpenClaw发布了最新4.20版本。

这次最大亮点就是官宣原生支持,国内月之暗面最新开源的超强Kimi K2.6,把这款热门模型的适配度拉满。

此外还公布了不少智能体、安全、BUG的优化。

详细地址:https://github.com/openclaw/openclaw/releases/tag/v2026.4.20

支持Kimi K2.6,核心体验大升级

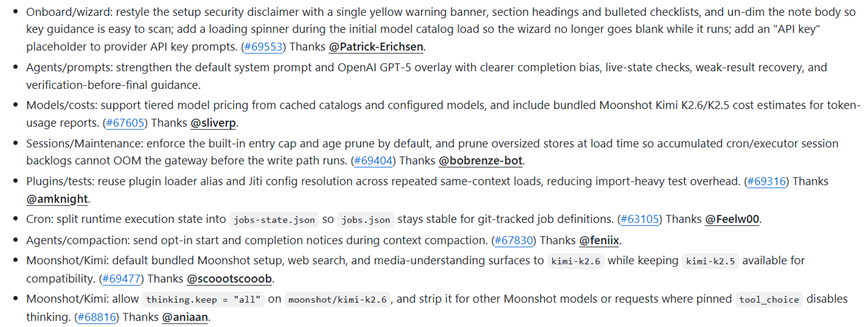

这次更新的重头戏,就是对国产开源Kimi模型的深度适配,内置的基础配置、网页搜索还有媒体理解功能,现在默认都直接用上K2.6了。

毕竟新版本的能力和体验都更优,同时开发团队也很贴心地留着K2.5没删,老项目或者需要兼容的场景还能继续用,不用怕更新后旧配置出问题。

还专门给K2.6加了个专属的思考保留配置,能把模型的思考过程全留着方便排查,其他Kimi模型如果禁用了思考功能,这个配置还会自动失效,不用手动改来改去,特别省心。

模型成本这块的更新对精打细算的朋友太友好了,现在能直接支持分层定价,从缓存和配置里直接读取对应价格。

token使用报告里还专门加上了Kimi K2.6和K2.5的成本预估,花了多少钱、哪个模型更费钱,一眼就能看明白,再也不用自己手动算来算去,成本管控更轻松。

智能体的核心能力也做了深度强化,默认的系统提示词和GPT-5的配置都做了针对性优化,简单说就是现在模型补全内容的时候更贴合实际需求,不会再答非所问。

还会实时检查自身运行状态,就算偶尔出了低质量的结果也能自动恢复,给出最终答案前还会多一层验证环节,不用再担心模型瞎回答踩坑。

还有大家最头疼的会话管理问题,这次也彻底解决了,之前最怕的就是会话堆太多导致网关内存溢出,这次直接默认开启了会话数量上限和按时间自动清理的规则。

加载的时候还会自动清理超大的存储文件,相当于给网关配了个24小时自动管家,不用再手动清理,也不用担心里程碑堆多了卡崩闪退。

另外终端日志的处理速度也提上来了,之前清理日志里的特殊字符是循环挨个清,效率特别低,现在直接用正则一次搞定,处理速度快了不少,还没改原来的清理规则,不会出任何兼容问题。

模型与工具适配

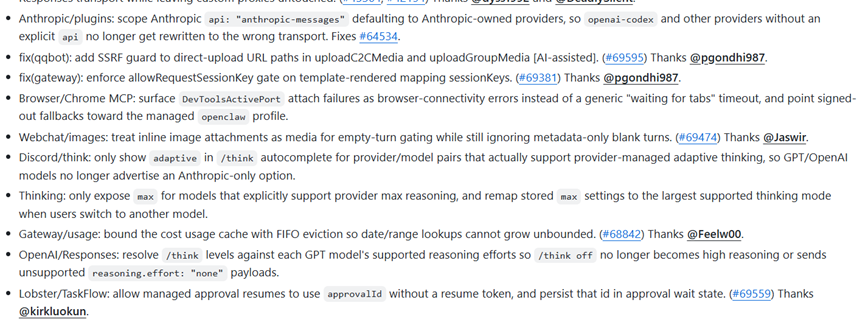

这次更新把各个主流模型和工具的适配坑全填了,用起来再也不用频繁踩雷,尤其是OpenAI Codex。

之前有旧的传输配置会和原生的通道冲突,导致请求失败,这次全做了标准化处理,自定义代理还能保留自己的原有设置,不用重新配置,省了大把时间。

Anthropic的插件也加了作用域限制,不会再把其他模型的请求错误导向到Anthropic的通道里,之前遇到过这个问题的朋友应该懂,终于不用再排查半天的路由错误了。

思考功能的适配也变得更智能了,之前不管什么模型都无脑显示max参数,导致很多不支持的模型选了之后直接报错,现在只给明确支持最大推理能力的模型开放这个参数,切换模型的时候。

之前设的max值还会自动换成新模型支持的最高级别,不用手动调整,彻底避免因为参数不兼容导致的请求失败。

Discord里的/think指令也做了优化,之前GPT模型会显示只有Anthropic才支持的自适应思考,点进去又用不了,特别误导人,现在只会展示对应模型真的能用的功能,再也不会白忙活。

还有插件的加载和启动环节,现在重复加载相同上下文的时候,会自动复用加载器和配置解析结果,不用每次都重新来一遍,测试的时候能省不少系统资源。

插件的依赖也会乖乖装在自己的独立目录里,不会和核心模块混在一起导致冲突,网关重复启动的时候,只要依赖装过了就不会再弹冗余日志,界面干净多了。

这次还新增了独立运行时注册协议,插件执行器能自己管理任务的生命周期,不用再动核心的代码,开发插件的时候更灵活,也不容易搞崩整个网关。

安全与性能修复

安全方面,现在会直接屏蔽不可信工作区里所有OPENCLAW开头的环境变量,不会再静默继承这些控制变量,避免恶意配置搞崩网关或者泄露敏感信息。

QQ机器人的文件上传接口加了SSRF防护,模板渲染的会话密钥也加了严格校验,不会再出现越权访问的问题。

设备配对的权限也做了收紧,非管理员的设备只能管理自己的配对信息,不能看其他设备的内容,也不能审批别人的配对请求,管理员还是有完整权限,兼顾了安全和易用性。

智能体的配置防护也做了强化,模型驱动的配置修改,再也不能改沙箱、插件信任、网关认证这些核心路径,也不能通过改智能体的内置配置绕开防护,彻底避免模型被恶意诱导后修改关键配置,导致网关出问题。

网关的websocket广播也加了权限控制,聊天、智能体这些核心信息的广播,需要对应的权限才能接收,配对设备和节点角色不会再被动收到无关的聊天内容,有效保护数据隐私。

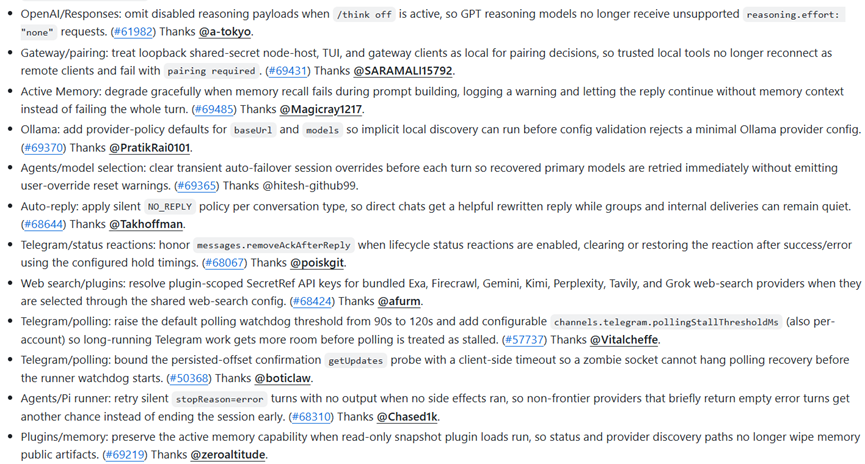

性能和稳定性上,主动记忆功能做了优雅降级处理,要是记忆召回失败,不会直接终止整个回复,只会记录一个警告日志,然后继续生成内容,只是少了记忆上下文而已,不会因为一点小问题就卡壳。

网关启动的时候会延迟HTTP绑定,等websocket处理器装好再启动,避免刚启动的时候探测连接命中竞争窗口导致失败。

会话的成本计算也修好了,之前会重复计算单次运行的成本,导致账单虚高,现在会像代币计数器一样做快照,算多少钱再也不会多算几十倍,成本统计更准确。

还有内存泄漏的问题也彻底解决了,梦境叙事的子会话会标准化清理时间戳,用哈希密钥兜底清理,不会再一直占着内存导致网关越来越卡。

上下文压缩的时候,会重新加载内置资源并应用配置,不会再丢失压缩设置,小额度截断的时候也会保留源内容,不会只输出一堆标记,实用性拉满。

其他细节优化

除了这些大的优化和修复,这次更新还改了超多日常使用的小细节,每个都能解决一个让人别扭的小问题。

比如执行YOLO模式的时候,之前安全级别拉满且关闭询问的情况下,网关托管执行会被直接拒绝,现在这个问题修好了,能直接运行解释器的标准输入和HereDoc形式,不用再绕弯路。

安装引导的终端界面会在新进程里启动,保留配置的同时还能干净恢复终端状态,不会把网关密钥暴露在命令行里,安全又省心。

会话重置的时候,执行new或者reset命令,会自动清除自动获取的模型、服务商配置,但是会完整保留用户自己手动选的设置,不会再出现切换会话后还绑着之前的兜底配置的情况,个性化设置更持久。

Ollama也加了默认的服务商策略,极简配置也能顺利通过校验,不用再填一堆额外的信息,新手也能轻松配置。

定时任务的修复也特别多,现在会直接拒绝模糊的投递配置,避免配错多渠道或者目标ID导致任务故障;延迟排队的回复会保留最后活跃的聊天窗口,不会发错地方。

显式设置不投递的任务,不会再记录虚假的失败信息,日志更准确。还有Windows系统里的定时任务命令行,现在能正确解析PowerShell风格的允许列表,不会把多个工具项合并成一个,配置终于能正常生效了。

诊断工具也做了升级,现在会直接展示待处理的配对请求、权限升级偏差还有token不匹配的修复步骤。

用doctor--fix的时候,不会再出现修复完还不知道哪里出问题的情况,排查问题更高效。

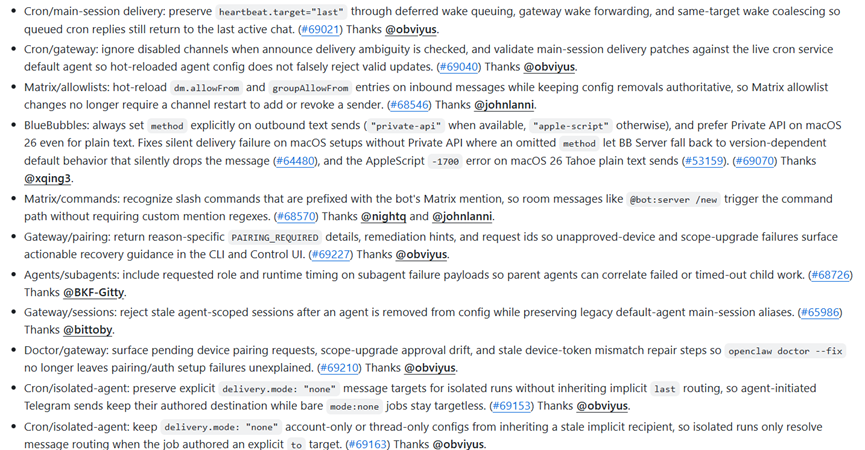

上面只是部分更新解读,如果想了解全部内容,小伙伴们可以直接查看原日志哈。

想系统掌握AI核心技能、获取行业认可资质?

CAIE注册人工智能工程师认证

助你拓宽职业赛道,成为AI领域持证实力派

企业、高校及渠道合作

请联系微信:FYLlaoshi

完 谢谢观看