2026-03-22

通常大模型智能体落地后很容易陷入静态困境,用户任务持续变化但模型能力原地踏步,会出现停服重训影响使用,积累的交互数据无法复用,跨任务知识也难以互通等问题。

介绍一个刚开源好用的MetaClaw,可以让部署在实际场景的AI智能体实现边用边进化,全程零停机。

还能通过双重机制加持,让普通模型性能追平顶尖模型,实测中端到端任务完成率暴涨8.25倍,文件检查完成率相对提升185%,真正破解了智能体落地进化的核心难题。

开源地址:https://github.com/aiming-lab/MetaClaw

咱们先唠唠现在的痛点,不然不知道这药方开得有多准。现在的适配方法大致分三类,但都有点瘸腿。

记忆类方法就像是囤积癖,存了一堆原始交互轨迹,看着挺多,其实全是废话,提炼不出能复用的行为逻辑。

Skills库类方法倒是把经验压缩成了指令,可它跟模型权重优化是脱节的,永远是个静态的外挂。

强化学习类方法听起来高大上,但要么只能在小范围离线练练,要么就被老数据里过时的奖励信号带沟里去,越练越抽抽。

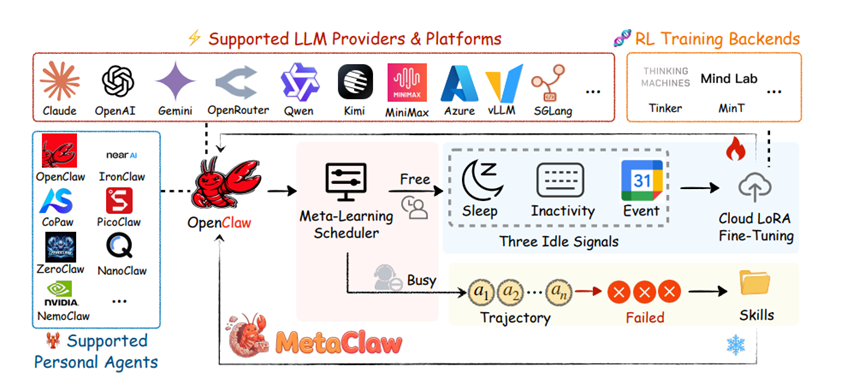

MetaClaw能管用核心就在于搞了个快慢结合的双重进化,而且脑子特别清醒,知道啥时候练、练啥数据。

其实这框架其实就像个元模型,底下是基础的大模型参数,上头挂了个能进化的Skills库。

Skills库像个随身老军师,推理的时候会把相关指令塞进提示词里,手把手教模型怎么干活。

咱们先说这个Skills驱动的快速适配,这玩意就像是给智能体打即时补丁,秒级生效,完全不需要动模型的底层参数。

智能体干活总有栽跟头的时候,以前栽了就栽了,现在它会把这些失败轨迹收集起来,扔给一个叫Skills进化器的大脑。

这个大脑分析完失败案例,立马就能提炼出避坑指南一样的新Skills,存进Skills库。下次再遇到类似情况,直接通过提示词注入,模型立马就知道怎么躲开。

但这光有外挂Skills还不够,底子也得练。这就得提那个机会主义策略优化。

它就是趁着用户空闲、不用模型的时候,悄悄在后台搞训练,完全不耽误正常业务。

有个特别聪明的调度器,会盯着用户配置的睡眠窗口、系统有没有活动,甚至还会看日历上的会议安排。只要发现你在忙别的,它就启动云LoRA微调,结合强化学习练内功。

这里头还有个特别精妙的设计,就是Skills生成版本控制。这事挺琐碎,但特关键。所有的交互轨迹都会被打上Skills库的版本标签,谁是支撑数据,谁是查询数据,分得清清楚楚。

支撑数据就是旧Skills库下栽跟头的记录,拿来生成新Skills,用完就扔;查询数据才是新Skills库上线后的交互轨迹,只有这类数据才有资格拿去训练模型权重。

每次Skills库一升级,缓冲区里那些过时的老数据立马清空。

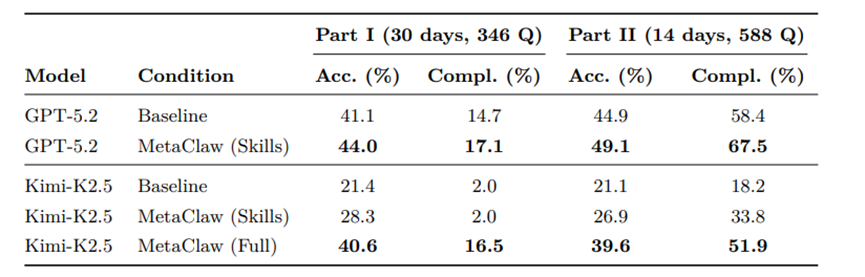

MetaClaw的实测能力特别强劲,在MetaClaw-Bench基准测试和AutoResearchClaw自主研究管道展开双重验证,选用GPT-5.2和Kimi-K2.5两款模型做对比实验,结果很亮眼。

MetaClaw-Bench模拟44个工作日的934个连续CLI任务,分两部分侧重执行可靠性和规则内化。

Skills适配对模型的提升效果随基础能力降低而提升,GPT-5.2基础准确率41.1%,开启后提升至44.0%;

Kimi-K2.5基础准确率仅21.4%,开启后飙升至28.3%,相对提升32.2%。

而Kimi-K2.5开启MetaClaw完整框架后,准确率直接涨至40.6%,几乎追平GPT-5.2基础水平。

端到端任务完成率从2.0%升至16.5%、暴涨8.25倍,文件检查完成率从18.2%升至51.9%、相对提升185%。

更难得的是,这玩意儿在23阶段的自主研究管道测试里,仅仅开了个Skills适配,就展现出了强大的跨领域泛化能力。

阶段重试率降了快四分之一,优化循环次数少了40%,这说明模型变聪明了,少走弯路了。

想系统掌握AI核心技能、获取行业认可资质?

CAIE注册人工智能工程师认证

助你拓宽职业赛道,成为AI领域持证实力派

企业、高校及渠道合作

请联系微信:FYLlaoshi

完 谢谢观看