2026-03-21

英伟达刚开源的最新专家混合模型Nemotron-Cascade-2-30B-A3B, 总参数量300亿,仅激活30亿。

虽然模型的参数并不是很高,但英伟达公开表示该模型已经拿下在国际数学奥林匹克和信奥赛上都拿了金牌,这还真挺罕见的。

此外,在本地部署方面英伟达也进行了大量优化,单卡4090就能轻松跑起来。

开源地址:https://huggingface.co/nvidia/Nemotron-Cascade-2-30B-A3B

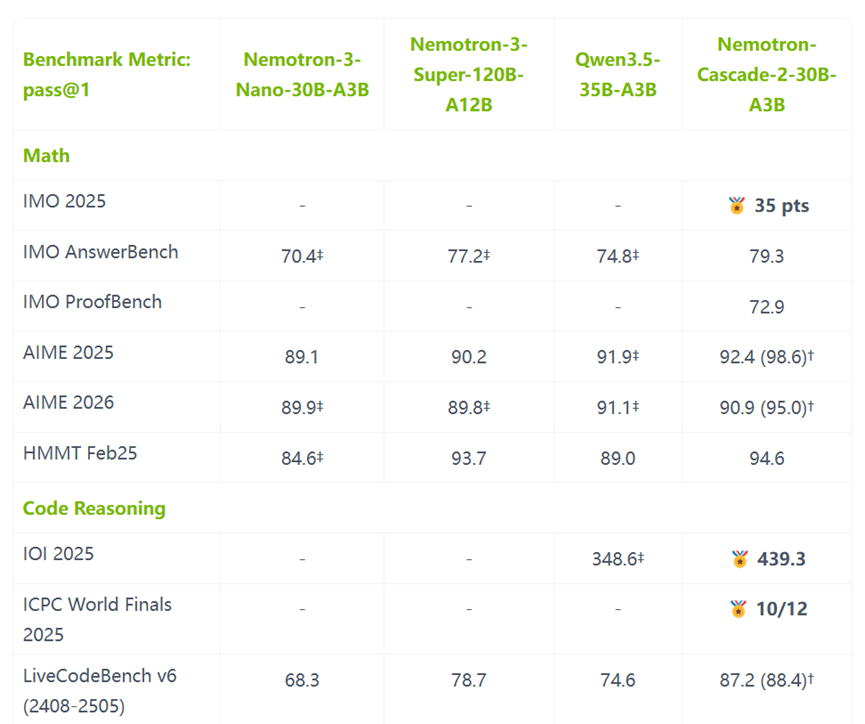

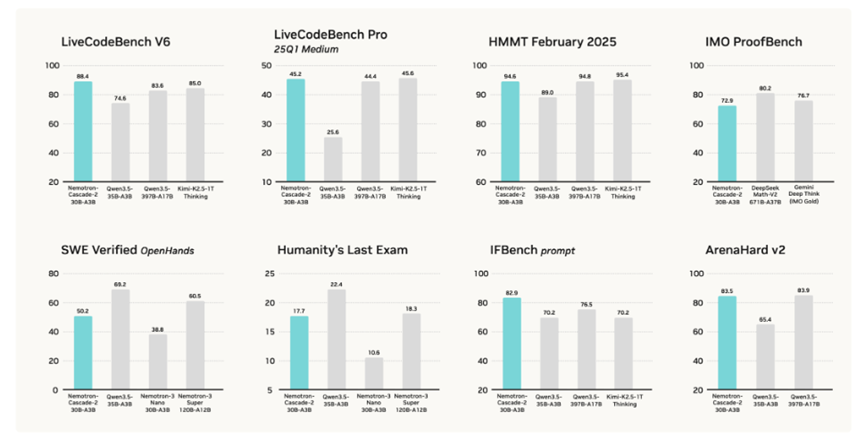

咱先唠唠Nemotron-Cascade-2的技术特点。首先这个数学推理是真的硬核,在国际数学奥林匹克2025年的题目上拿了35分,差不多真人参赛选手拿金牌也在这个分数段。

而且不是那种只会套公式的,是真的会推理证明题,证明部分能拿到72.9分,这已经是相当高的水平了。

然后代码能力也相当能打,信奥赛2025拿了439.3分,同样是金牌水平。在实际编程测试LiveCodeBench上也能到87.2%,这个分数在目前的开源模型里算是相当靠前的了。

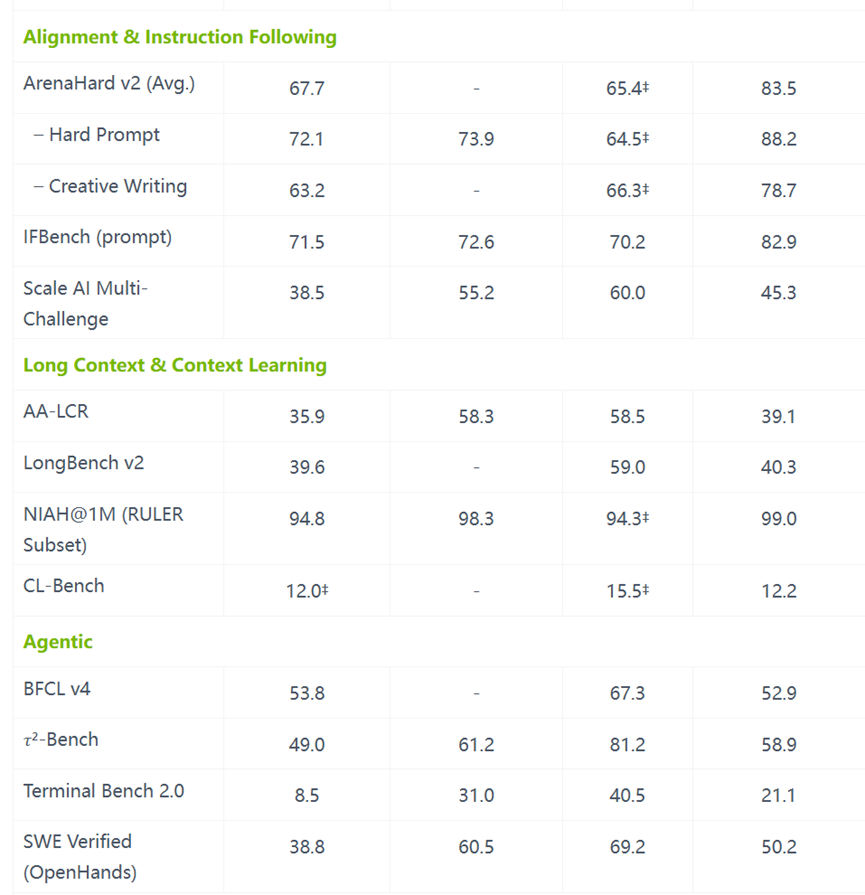

有意思的是,这模型在创造性写作和指令遵循上也表现不错,ArenaHard V2测试能到83.5分,尤其是那种难题提示,能到88.2分。

就是说你让它写个创意故事,或者让它严格按你的格式要求来回答,都挺听话的。

同时这模型还支持工具调用,能自己写Python代码解决问题,或者当个智能客服代理用。

这个工具调用其实就是在系统提示词里告诉模型它有哪些工具可用,比如给你一个Python代码执行器,模型遇到需要计算的题目时就会自己写代码去跑,然后把结果给你。

用法跟刚才差不多,就是在系统提示词里加上工具描述,剩下的交给模型自己判断就行。

多轮对话也类似,就是记得把上一轮的回复也加到messages里,这样模型才能知道你们之前聊了啥。

有个细节要注意,如果上一轮用了思考模式,在历史记录里只会保留最终总结部分,不会把整个推理过程都塞进去,这样能省不少上下文空间。

当然了,这模型也不是那么完美的。长文本处理能力相对弱一点,在长上下文测试里表现一般。

如果你有那种几十万字要处理的场景,可能不太合适。另外多语言能力也就中规中矩,毕竟主要优化的是数学和代码。

还有就是这个模型的架构是MoE的,就是混合专家模型,虽然总参数有300亿,但每次只激活30亿。

这个设计有好有坏,好处是快且省资源,坏处是某些场景下可能不如同等激活参数的稠密模型那么细腻。

最后提一嘴,这个模型用的是ChatML模板,温度建议设成1.0,top_p设成0.95,这样效果最好。

如果你需要处理复杂的数学问题、代码生成任务,或者想试试这种能自己推理的模型,这个Nemotron Cascade2确实值得一试。

尤其适合那些对推理能力有要求的场景,竞赛辅导、代码助手、科研辅助之类的。

想系统掌握AI核心技能、获取行业认可资质?

CAIE注册人工智能工程师认证

助你拓宽职业赛道,成为AI领域持证实力派

企业、高校及渠道合作

请联系微信:FYLlaoshi

完 谢谢观看